DECÁLOGO COMPLIA DE IA RESPONSABLE

“Porque la confianza no se programa: se construye.”

1. La IA debe servir al ser humano, nunca sustituir su juicio.

Toda decisión automatizada debe ser supervisada, comprendida y validada por personas. La IA es un copiloto estratégico, no un reemplazo de la responsabilidad humana. La tecnología potencia las decisiones humanas; nunca las reemplaza.

2. La transparencia no es opcional: es un deber.

Toda persona (usuario, colaborador o ciudadano) tiene derecho a saber cuándo, cómo y por qué interviene la IA. La claridad genera confianza: por eso implementamos Avisos de Uso de IA, Model Cards y mecanismos de explicación accesibles. La transparencia es la base de la confianza digital.

3. La justicia algorítmica es parte del cumplimiento.

Sin equidad no hay Compliance real. Los modelos deben garantizar justicia demográfica, de oportunidad y de necesidad, previniendo toda forma de discriminación, sesgo o exclusión. La Dimensión de Ética del Modelo COMPLIA lo hace obligatorio, no opcional.

4. La privacidad de las personas está por encima de la ambición de los datos.

Los datos personales únicamente pueden usarse con bases legales claras, consentimiento informado y principio de minimización. La IA no debe invadir ni inferir información más allá de su propósito legítimo. Porque los datos tienen dueño: tú.

5. La seguridad es el cimiento de la confianza.

Toda solución de IA debe ser robusta, resiliente y protegida contra ataques o manipulaciones. La Ciberseguridad no se delega ni se añade al final: es una dimensión transversal del Modelo COMPLIA, activa en cada etapa del ciclo de vida del sistema. Si no está integrada desde el diseño, no es IA Responsable.

6. La explicabilidad es un derecho y una obligación.

Cada sistema de IA debe poder explicar sus decisiones y proporcionar razones auditables. Si no se puede explicar, no se puede confiar. Si no se puede auditar, no se debe usar.

7. La rendición de cuentas es intransferible.

El responsable siempre es humano. Cada modelo, decisión o impacto debe tener roles y procesos claros, bajo un esquema de supervisión y un Comité Ético que garantice la trazabilidad de las acciones y la gobernanza activa del sistema.

8. La ética no es una etiqueta: es una práctica continua.

No basta con principios en papel. La ética se ejerce cada vez que se corrige un sesgo, se revisa un modelo o se escucha a un usuario. La ética tiene su base principal en los valores, misión y visión de las organizaciones. La Dimensión 7 de Mejora Continua del Modelo COMPLIA institucionaliza esta práctica, convirtiendo la ética en un proceso auditado y medible, no en una declaración de intenciones.

9. La IA debe contribuir al bien común.

Cada proyecto de IA debe crear impacto positivo en la sociedad y el entorno. La innovación responsable impulsa desarrollo económico, social y humano, respetando derechos, dignidad y sostenibilidad. Toda aplicación debe generar valor sin dejar a nadie atrás.

10. La responsabilidad es compartida.

La IA Responsable no es tarea de un área: es una cultura organizacional. Desde el desarrollador hasta el Consejo de Administración, todos somos corresponsables del uso ético de la IA. La cultura COMPLIA forma líderes que integran las 3 Etapas y las 7 Dimensiones del Modelo como parte de su ADN directivo.

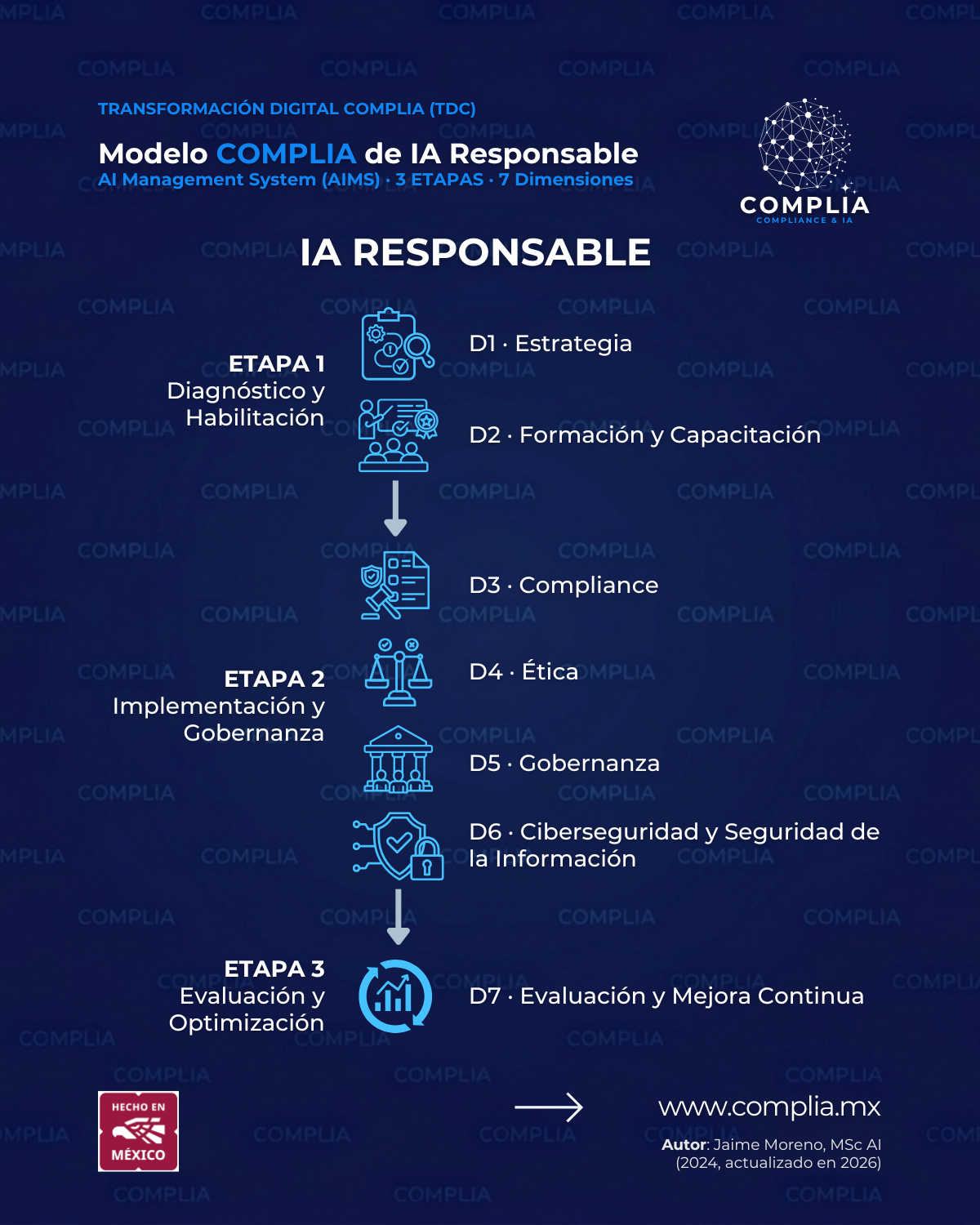

Este Decálogo es la brújula ética del Modelo COMPLIA de IA Responsable (AIMS). Sirve como marco de referencia vivo para las 3 Etapas y 7 Dimensiones que guían a organizaciones, líderes y equipos hacia una adopción de IA que sea legal, confiable, escalable y con propósito.

Aplica a: Políticas internas y marcos éticos · Procesos de auditoría, capacitación y gobernanza · Compromisos públicos de transparencia y sostenibilidad digital.

El Modelo COMPLIA de IA Responsable (AIMS) (construido por Jaime Moreno, MSc en Inteligencia Artificial) combina 3 Etapas y 7 Dimensiones para acompañar a líderes, empresas y gobiernos en la construcción de su propio Marco de IA Responsable: con visión práctica, ética y sostenible.

Cumplimiento con regulaciones presentes y futuras · Reducción de riesgos reputacionales y legales · Confianza de clientes, socios e inversores · Innovación alineada a valores y propósito.

COMPLIA: IA Responsable.

Porque liderar con IA exige más que tecnología: exige confianza.

*Todos los derechos reservados. Queda prohibida su reproducción parcial o total sin consentimiento expreso del autor.

*Todos los derechos reservados. Queda prohibida su reproducción parcial o total sin consentimiento expreso del autor.